Qianxun Intelligence has once again fully accelerated its fundraising pace.

On 7 April 2026, Qianxun Intelligence announced the completion of a new round of RMB 1 billion funding. This round was co-led by Shunwei Capital and Yunfeng Capital, with significant participation from Dacheng Capital, a leading RMB fund, Galaxy Yuanhui, Turing Fund, Xinding Capital, Gengxin Capital, and others.

這已是它30 天內的第二筆大額融資。就在不久前的2 月,公司剛剛完成近20 億元融資。兩輪疊加,累計融資額直接來到30 億元。

更有意思的是,這一輪出現了一個極具話題性的組合:雷軍(順為)+ 馬雲(雲鋒),首次在具身智能賽道同場領投。

過去,他們各自押中了行動互聯網、電商、智能硬體、雲計算等關鍵週期。這次,他們在機器人、尤其是仍處早期階段的具身智能領域攜手下注,表明這個方向正從技術想像走向資本共識,開始進入由巨頭背書、資本高度集中的排位淘汰賽。

千尋智能成立於 2024 年 1 月,由機器人領域連續創業者韓峰濤、頂尖 AI 科學家高陽、機器人出海先行者鄭靈茵聯合創立。

創始人兼 CEO 韓峰濤曾任珞石機器人聯合創始人兼 CTO,主導交付近百款機器人型號,具備深厚的工程化與量產能力。聯合創始人高陽畢業於加州大學柏克萊分校,師從計算機視覺大師 Trevor Darrell,現為清華大學交叉信息研究院助理教授,其帶領團隊開源的 Spirit v1.5 模型在 RoboChallenge 榜單中超越美國頭部模型 Pi0.5,成為首個登頂的中國開源具身模型。聯合創始人鄭靈茵則是工業機器人出海的先行者,曾從 0 到 1 搭建海外事業部,帶領團隊深耕多個海外市場並迅速實現商業化成果轉化。

三位創始人分別覆蓋 AI、機器人、商業化三大核心能力,共同構成業內罕見的「六邊形戰士」團隊,這也是其在 30 天內獲得 30 億元融資、順為資本與雲鋒基金同台重倉的底層信心所在。這樣的組合,使千尋智能從成立之初便兼具世界級技術前瞻與商業化落地基因。

韓峰濤曾指出,2026 年,拼的是數據規模和模型性能。今年最重要的一件事,不是擴張場景,而是把具身模型做到全球 Top 3。要做到這一點,賬上必須有足夠多的錢。

因此,閃電戰式連續融資本質是以資本密度換取時間優勢,快速堆疊資源、拉開性能差距,提前鎖定頭部席位。同時,老股東在這一輪持續加注,意味著投資人已從觀望驗證轉向加速押注。

那麼,千尋智能,究竟是憑什麼拿到這張加速入場券?它的護城河,已經挖到多深了?

資本為何願意持續加碼?答案:模型已提供階段性解答。

在今年 1 月,千尋智能開源了具身模型 Spirit v1.5。在公開評測中,這個模型直接超越當時最強的開源模型 Pi0.5。

但最打動資本的,還是能力曲線的拐點。

Spirit v1.5 已展現出較為穩定的零樣本泛化能力——無需額外訓練,即可完成擦拭、開合鉸鏈、處理柔性物體等一系列複雜操作。

In other words, robots are no longer just learning to perform a single task, but have gained the ability to transfer skills across tasks, offering a glimpse of the potential for embodied intelligence to liberate human productivity.

背後對應的是一條與大語言模型(LLM)高度相似的技術路徑:把模型做大,把數據喂足,持續迭代,然後相信能力的「湧現」。

具體來看,Spirit v1.5 是一個端到端的 VLA(Vision-Language-Action)統一模型。它不執著於還原世界的全部細節,也不強調中間那層顯式的世界模擬,而是直接學習從感知到動作的映射關係。

訓練方式也很 LLM 化。只不過,把文本數據換成了機器人數據。先用海量互聯網視頻進行預訓練,建立基礎世界理解,再用真實交互數據進行對齊——先獲得泛化能力,再逼近具體任務。

結果,在更低的算力和參數規模下,反而跑出了更強的泛化表現。

就在幾天前,這條路徑也得到了矽谷同行的「同頻共振」。

4 月 3 日,矽谷具身智能公司 Generallist AI 發布基礎模型 GEN-1,利用 50 萬小時真實物理交互數據,驗證了具身智能領域的 Scaling Law。效果有多猛?

這些機器人將多項物理任務的平均成功率從 64% 大幅提升至 99%;執行速度幾乎與人類一樣快,達到現有最先進系統的約 3 倍,還能臨場即興發揮。更誇張的是,每一項能力的獲得,僅需約 1 小時的機器人數據。

公司 CEO Pete Florence 指出,目前機器人領域所發生的事情,與人們打開 GPT-3 並要求它寫一首全新的五行打油詩(limerick)時的情形很相似。

類似的觀察,也得到千尋團隊的驗證。「我們團隊也發現了具身智能領域的 Scaling Law,數據每增加 10 倍,結果中就會多一個 9。」高陽曾這樣形容這條曲線的陡峭程度。我們正處於具身智能的 Scaling Law 時刻,由於機器人的數據更難獲取,我認為機器人的 GPT-4 需要更長時間,可能需要 4-5 年。

It can be said that the capital injection is directed toward a technology pathway that has been preliminarily validated and offers higher cost-effectiveness and scalability potential.

在具身智能領域,幾乎所有人都有一個共識:數據採集是一個根本性的瓶頸。

大模型可以消化互聯網的海量語料,但機器人不行——在體力勞動的世界裡,沒有維基百科。表面上看,大家都在比拼模型,但更底層的競爭其實是數據引擎。「為了實現擴展,我們會不擇手段。」 Pete Florence 直言不諱。

既然相信擴展定律,那麼什麼樣的數據體系,既能低成本獲取,又能持續擴張,還具備足夠多樣性?

過去成功率超過 90% 的機器人通用模型依賴於極其昂貴且難以擴展的大規模遠程操作數據集(例如 Physical Intelligence)。但 Generallist AI 自主研發了「數據手」(data hands)——一種佩戴在手腕上的雙指穿戴設備,將人的雙手轉變為類似機器人的夾具,從而收集視覺和感官數據。

結果,GEN-0 和 GEN-1 的進展驗證了這一數據引擎也能實現高水平精通——它們並未使用機器人數據,僅採用了人類佩戴低成本可穿戴設備進行數百萬項活動所產生的數據。

Qianxun Intelligence is also advancing a scaling roadmap centered on diversity.

在硬體方案上,千尋也選擇了可穿戴方案,但走得更遠。為了讓模型學習人類級精細操作,他們採用了三指結構的設計——智能主機配備 26 個自由度,每個關節集成力傳感器,搭載三指靈巧手。但技術挑戰也顯著提升。三指結構在可穿戴數據採集中面臨更高的自由度、更精細的力控要求及更複雜的動作映射。

目前,千尋的可穿戴設備已經迭代到第五代,數據可用性從 30% 提升到 95%,同時成本被壓縮到遙操作的十分之一左右。

需要注意的是,與 Generallist AI 完全倚重可穿戴數據不同,千尋構建的是一个多源融合的數據引擎。

在預訓練階段,千尋智能除了使用大量可穿戴數據外,還積極融合互聯網視頻進行預訓練,以獲取通用常識和基礎能力。隨後,引入真機的遙操作數據,進行精細的 SFT(監督微調),提升模型在實際任務中的表現。最後,透過強化學習進一步優化:讓模型在真實環境中持續 roll-out,不斷生成新數據,反哺模型。

截至目前,千尋已累積超過 20 萬小時的真實互動數據,來源涵蓋互聯網視頻、遙操作、可穿戴採集等多個渠道,且此數字仍在快速增長,預計於 2026 年將突破 100 萬小時。截至 2026 年 4 月,千尋智能數據採集團隊也將達至千人規模。

值得一提的是,千尋對數據的理解,也經歷了一次本質性的轉變。

他們不再執著於行業主流那套精雕細琢的腳本化數據,而是轉向一種更開放的多樣化採集範式:不再嚴格規定動作路徑,而是圍繞任務目標,讓執行過程自然展開:允許失敗、允許打翻、允許中斷,再繼續完成。

這帶來的變化是根本性的,模型學會的不再是這件事該怎麼做,而是遇到類似情況時該如何處理。在相同數據規模下,這種數據分佈顯著提升了模型的遷移效率,同時降低了對算力的依賴。

在千尋的數據引擎中,真正決定飛輪能否轉起來的,不只是數據源,而是持續在真實環境中 roll-out 的能力。

韓峰濤曾總結說,走向真實場景,是為了拿到模型進化的燃料(數據)。商業化,是讓這一獲取過程變得可持續、可規模化。

這背後,其實也對應著一條清晰的中美路徑分化。在美國,一些公司可以長期圍繞基礎模型本身投入,用時間換能力上限;但在中國,沒有 demo、沒有落地信號,就很難持續獲得融資。大多數能活下來、甚至活得不錯的公司,多會選擇一條更折中的路徑。

通往通用 AI 的道路是一條長坡厚雪之路,不可能等到模型成熟後再尋找應用。唯有先讓機器人進入真實生產環境,參與真實業務運行,才能利用真實業務運行產生的海量數據,反哺模型,持續進化。

作為國內首家將多樣化數據採集路線從理論推向工程化、規模化,並在真實商業場景中完成雙重驗證的具身智能公司,千尋機器人堅持「沿途下蛋」。他們從可控場景切入,優先進入工業和服務業這兩類結構相對穩定、任務邊界清晰、利潤高且願意付費的領域,在驗證模型能力的同時支撐公司運營。

例如,在零售場景中,千尋與京東(亦為投資者之一)的合作正在加深。「小墨」已進入京東 MALL,上崗擔任咖啡師。在完成服務任務的同時,機器人也會同步採集多模態感知數據、關節運動軌跡以及精細力反饋信息。

這些來自真實零售環境的「專家級數據」,將直接用於具身模型的訓練與微調,形成「數據採集—模型迭代—能力提升」的正向閉環。

千尋智能機器人已正式在京東MALL上崗履職,承擔咖啡師。

雙方還計劃將具身智能進一步擴展至更多零售細分領域,包括數碼家電導購、巡檢導覽、自動化清潔等。同時,京東藥房也被視為核心突破口,機器人將參與自動分揀、精準配藥等高精度任務,探索無人化智慧藥房方案。

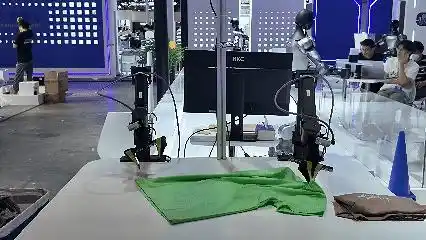

在進入京東 Mall 之前,千尋已在工業環境中完成了一輪驗證。「小墨」已登上寧德時代的動力電池包產線,承擔下線前的最終功能測試。截至目前,它已完成超過 1000 塊電池的插接作業,成功率穩定在 99% 以上,作業節拍也逼近熟練工人水平。

「小墨」已登上動力電池包生產線

具身智能在短期內還不會迎來落地即分勝負的時刻。但一個更清晰的趨勢已經出現——競爭,不再只是誰的數據更多,而是轉向誰能更高效獲取真實場景數據,以及誰能構建更高頻運轉的數據—模型飛輪閉環。

在完成階段性的估值躍遷後,千尋智能將一方面押注模型的泛化能力,一邊持續放大數據規模優勢,用真實世界的高頻反饋,加速模型迭代。

回看 2019 年的 GPT-2,也許不值一提,但隨著規模不斷擴大,通用化能力帶來的回報迅速放大。現在,同樣的拐點,正在機器人領域重演。

本文來自微信公眾號「機器之心」(ID:almosthuman2014),作者:Sia