- Tether 的 BitNet LoRA 框架可在智慧型手機、GPU 和消費性裝置上進行 AI 模型訓練。

- 系統減少記憶體使用並提升效能,VRAM 需求最多降低 77.8%。

- 使用者可在行動裝置上微調參數高達 13B 的模型,擴展邊緣 AI 的能力。

Tether announced 透過其 QVAC Fabric 平台推出新的 AI 框架,支援在消費級裝置上進行跨平台 BitNet LoRA 訓練。此更新讓十億參數模型可在智慧型手機和 GPU 上運行。首席執行官 Paolo Ardoino 分享了此項發展,並強調降低了成本,並讓更多人能使用 AI 工具。

跨平台 AI 訓練擴大訪問權限

QVAC Fabric 更新引入了對 BitNet LoRA 微調的跨平台支援。這使得 AI 模型可在不同硬體和作業系統上運行。

值得注意的是,該框架支援 AMD、Intel 和 Apple 的 GPU,包括行動晶片組。它還使用 Vulkan 和 Metal 後端以確保相容性。

根據 Tether 的說法,這是 BitNet LoRA 首次在如此廣泛的設備上運行。因此,用戶可以在日常硬體上訓練模型。

在消費級硬體上實現性能提升

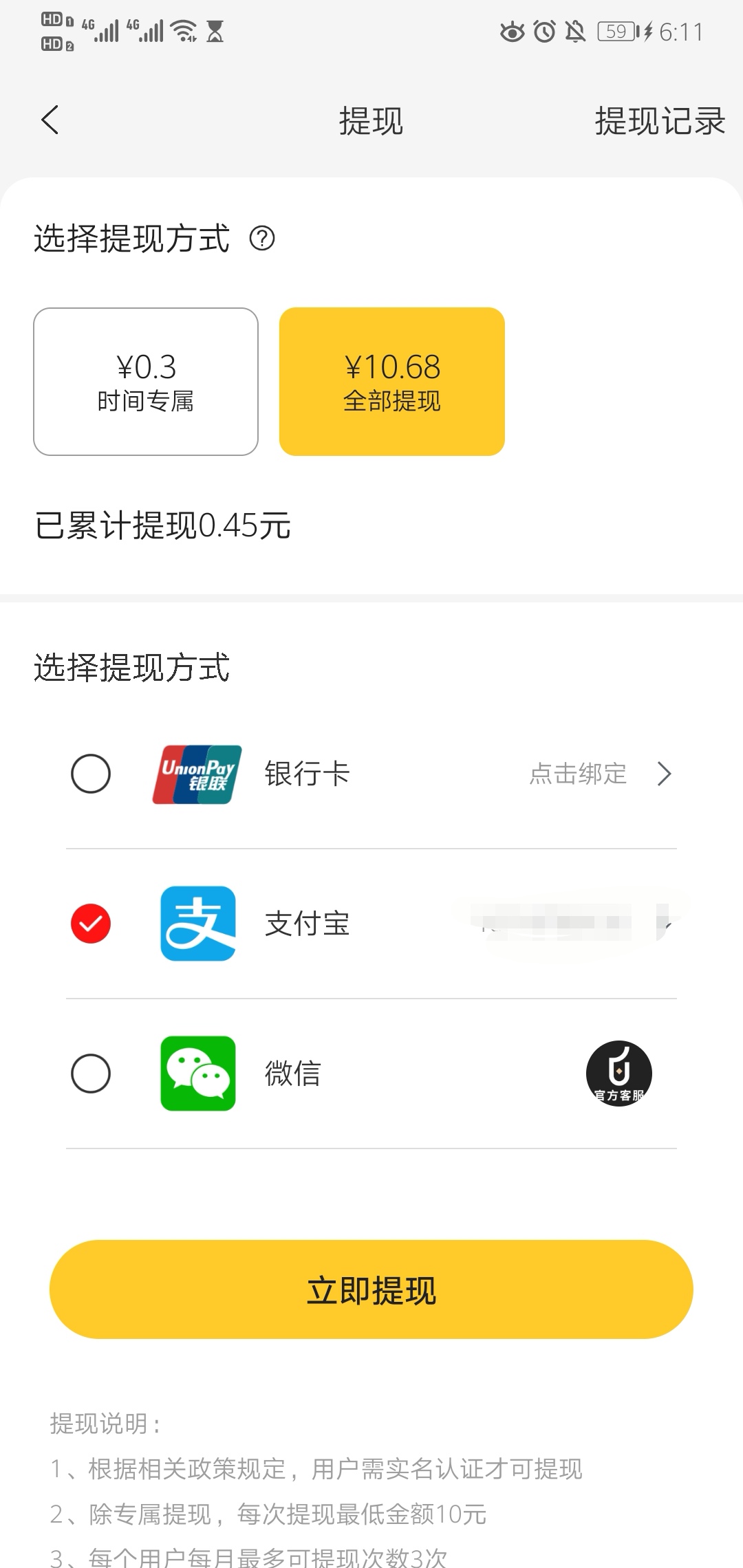

系統透過結合 BitNet 和 LoRA 技術,降低記憶體和運算需求。BitNet 將模型權重壓縮為簡化值,而 LoRA 則限制可訓練參數。

這些方法共同大幅降低硬體要求。例如,在行動裝置上,GPU 推理的速度比 CPU 快兩至十一倍。

此外,與全精度模型相比,記憶體使用量大幅下降。基準測試顯示,其 VRAM 使用量比類似系統減少高達 77.8%。

Tether 也展示了在智慧型手機上的微調。測試顯示,像 Samsung S25 這樣的裝置上,可在數分鐘內訓練出 125 億參數的模型。

行動裝置和邊緣裝置可處理更大規模的模型

該框架使較大的模型能在邊緣設備上運行。Tether 報告成功在 iPhone 16 上對參數高達 130 億的模型進行了微調。

此外,系統支援 Adreno、Mali 和 Apple Bionic 等行動 GPU,這使 AI 開發超越了專用硬體。

根據 Paolo Ardoino 的說法,AI 開發通常依賴昂貴的基礎設施。他表示,這個框架將能力轉向本地裝置。

Tether 表示,該系統減少了對中心化平台的依賴,並允許用戶直接在自己的設備上訓練和處理數據。