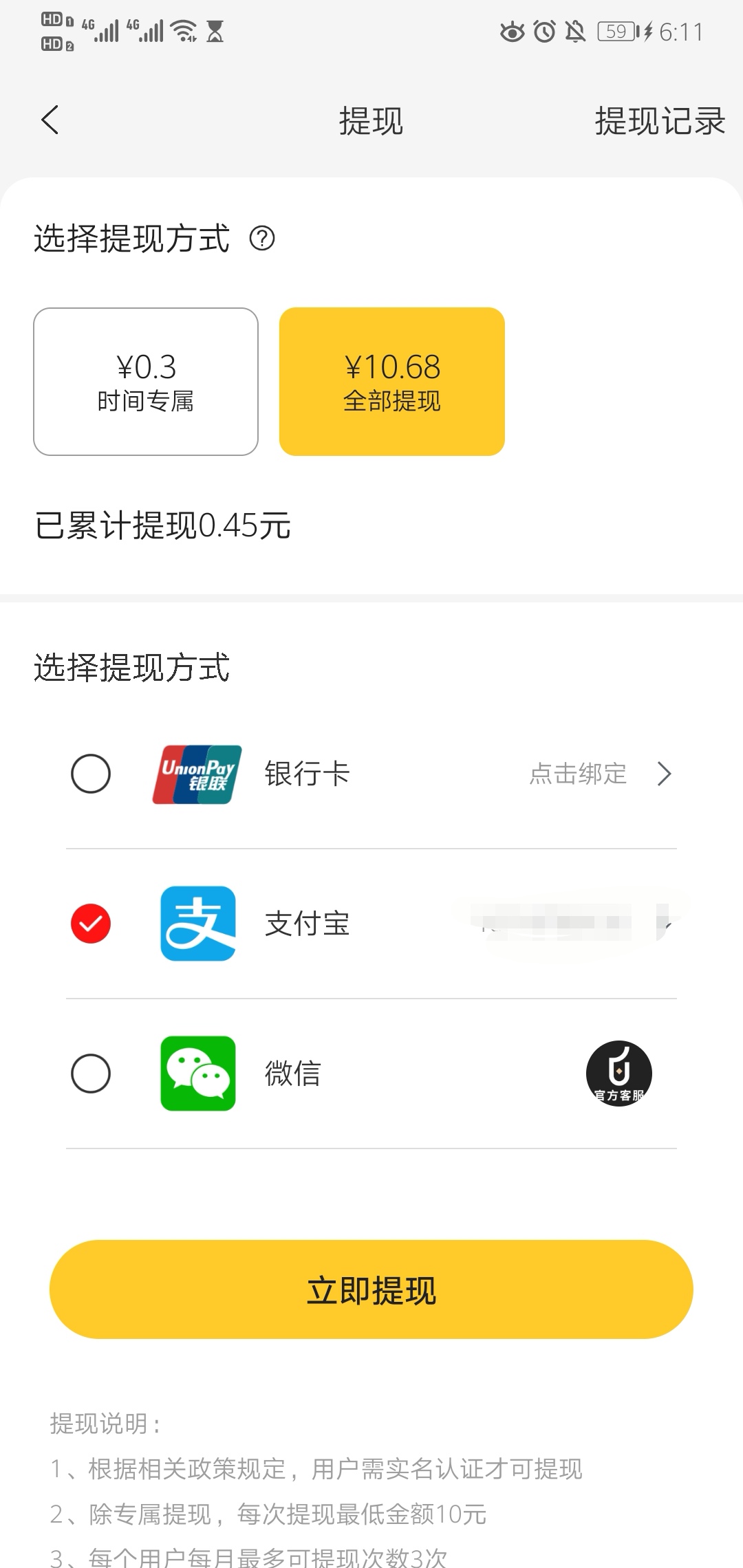

北京時間 2 月 28 日上午,Sam Altman 發了一條推文:「今晚,我們與美國陸軍部達成協議,將我們的模型部署到他們的機密網絡中。」

將時間往回撥大約十二小時,到北京時間 2 月 27 日晚上。同樣是他,坐在 CNBC 的 Squawk Box 節目鏡頭前,用平靜的語氣說:「對於 Anthropic,儘管我們之間有很多分歧,我基本信任他們這家公司。我認為他們真的在乎安全。」他還說:「我不認為五角大樓應該用《國防生產法》威脅這些公司。」

不到十二小時,同一張嘴,前後兩段話。這中間發生了什麼,值得慢慢說清楚。

兩份相似的條款,兩個不一樣的結果

將兩份合約的核心內容並排放置。

Anthropic 的要求:Claude 不得用於大規模監控美國公民,不得用於沒有人類介入的自主武器系統。

Altman 在推文中宣布協議時,援引了兩條相同的原则:「我們長期以來相信,AI 不應當被用於大規模監控或自主致命武器,人類在高風險的自動化決策中應當始終在場。」他還寫道:「五角大樓同意這些原則,將它們反映在法律和政策中,我們把它們寫進了合同。」

文字幾乎完全一樣。

一家被封禁,被列為「供應鏈風險」,被特朗普在 Truth Social 上親自罵為「激進左派覺醒公司」。另一家獲得了合約,進入了五角大樓的機密網絡,Sam Altman 在推文中使用了「reached an agreement」這個詞——平靜、商務,就像一筆普通的 B2B 交易完成交割。

相近的條款,為何結果完全不一樣?

答案不在條款裡,在條款背後的邏輯裡。

有一個背景事實需要先澄清:Anthropic 是這四家公司(另外三家是 OpenAI、Google、xAI)中,唯一被允許將 AI 接入五角大樓機密網絡的公司。OpenAI 的原有合約,僅涵蓋非機密的日常辦公場景。這次談判本質上是 OpenAI 想進入機密網絡,而五角大樓提出的入場條件,正是那個有爭議的「所有合法目的」條款。Anthropic 已經在內,但五角大樓要求拆除它進來時設置的安全門。

五角大樓不在意寫什麼,而是誰說了算

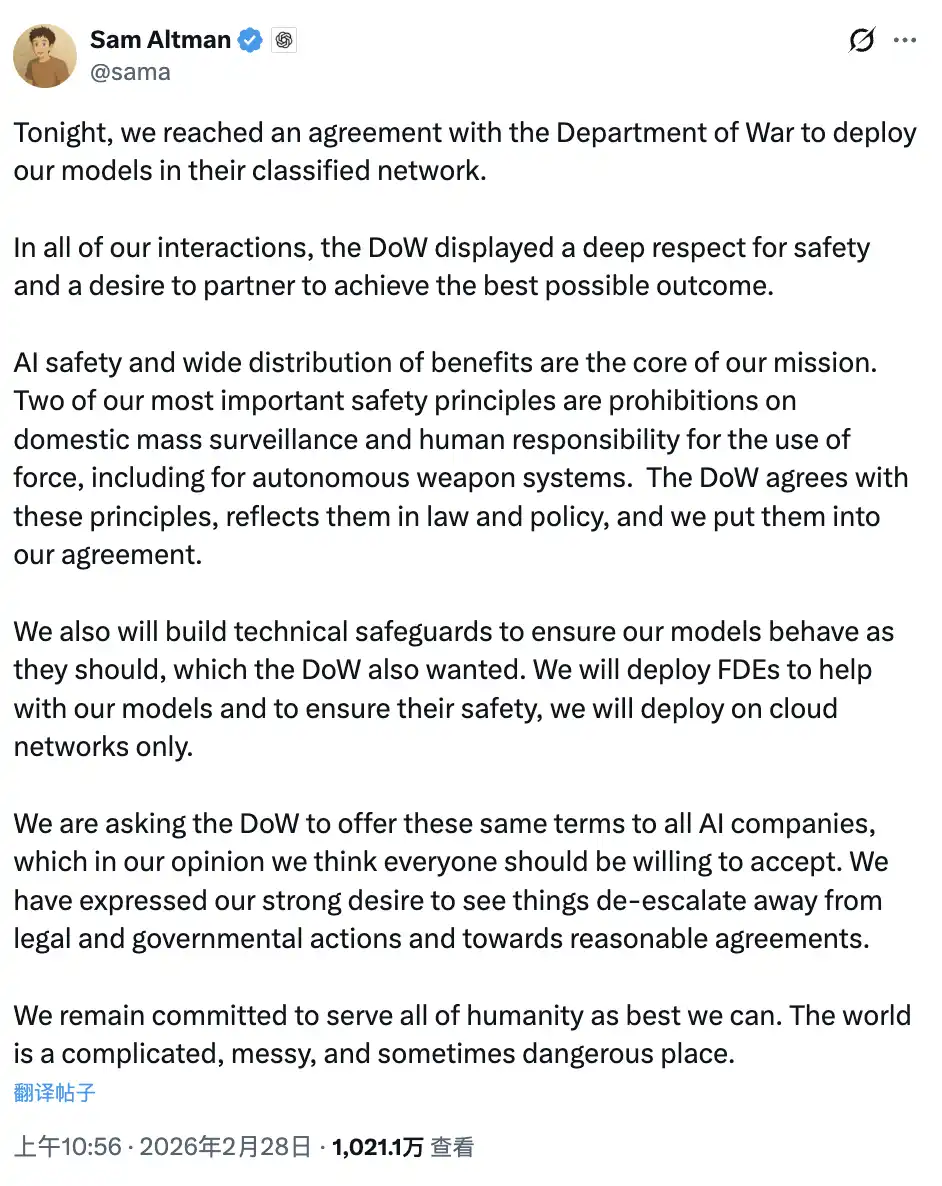

要理解這件事,需先理解 Anthropic 的 Dario Amodei 在那封公開信中到底說了什麼。

他寫道:「Anthropic 理解,軍事決策由五角大樓而非私人企業來做。我們從未針對特定軍事行動提出異議,也從未試圖以臨時方式限制我們技術的使用。」

然後他話鋒一轉:「但在極少數情況下,我們相信 AI 可能會破壞而非捍衛民主價值觀。威脅不會改變我們的立場:我們問心無愧,無法接受他們的要求。」

Anthropic 要求將原則明確寫入合約條款,形成強制性約束;若對方違反,其有權拒絕繼續提供服務。

五角大樓聽到的是什麼?一家私人公司告訴政府軍隊:在某些情況下,我可以不執行你的命令,邊界由我來劃定。

這對任何一支軍隊來說都是不可接受的。不是因為他們真的想搞大規模監控,而是因為「判斷權歸誰」這件事本身,是軍事指揮體系裡最敏感的神經。軍事採購負責人 Jerry McGinn 說得很直接:軍方承包商通常無權告訴五角大樓他們的產品可以怎麼用、不能怎麼用,「否則每份合約都要談具體使用場景,這不現實」。

OpenAI gave a completely different answer.

Altman 在備忘錄中告訴員工,OpenAI 將向五角大樓提議自建「safety stack」,一套由技術控制、政策框架和人工審核構成的多層防護系統,嵌在 AI 模型和實際使用之間。OpenAI 同時表示,可以向機密網絡內部派駐持有安全許可證的研究人員,持續追蹤 AI 行為;模型只部署在雲端,不進入無人機這類邊緣系統。

你來看,你來監督,你看見所有事情發生。如果出了問題,我們共同承擔,不是你來找我要解釋。

「規則寫死,我來執行」和「我來嵌入,你來監督」,這是兩種完全不同的權力關係,而五角大樓只接受後者。

OpenAI 最擅長的,恰好是五角大廈最想要的

這裡有一個令人有些不舒服的諷刺需要說清楚。

OpenAI 向五角大樓承諾的「技術透明」和「持續監控」,在它自己的用戶身上,已經實踐了一遍。

2025 年 8 月,OpenAI 在一篇關於用戶心理健康危機的官方博文裡,夾帶披露了一套新的監控機制:當系統檢測到用戶「計劃傷害他人」時,對話會被轉入專用管道,由一支經過培訓的人工審核團隊處理,這些審核員被授權將情況上報給執法機關。這是 OpenAI 主動發布的,但埋在一篇關注心理健康的長文段落中,反應平靜。

2026 年 2 月,就在這份合約簽署前不久,OpenAI 上線廣告系統並更新隱私政策,明確了一件事:免費和基礎付費用戶在使用 ChatGPT 時,系統會進行「會話內上下文分析」,根據對話話題向用戶展示相關廣告。例如,如果你在討論食譜,可能會看到外送服務的廣告。OpenAI 強調對話內容本身不會傳給廣告主,但分析行為是實時發生的。廣告於 2 月 9 日開始測試。

2025 年 11 月,OpenAI 的第三方分析服務商 Mixpanel 遭遇入侵,洩露了部分 API 用戶的姓名、電子郵件、大致地理位置、作業系統和瀏覽器資訊。OpenAI 隨後終止了與 Mixpanel 的合作,目前已有訴訟立案。事件主要影響 API 開發者用戶,普通 ChatGPT 用戶受影響的是透過平台提交過幫助中心工單的那部分人。

這就是那家向五角大樓承諾「技術透明、持續監控、讓你看見所有事情發生」的公司。

它最擅長的事,恰好是讓別人看進來,因為它已經習慣這樣對待自己的用戶。

Anthropic 相信規則能約束使用方,OpenAI 相信把自己的人嵌進去比任何條款都管用。前者是理想主義的合規邏輯,後者是現實主義的影響力邏輯。五角大樓選了後者,因為後者對它來說更熟悉,也更可控。

中間幾個小時發生了什麼?

時間回到北京時間 2 月 28 日凌晨,美東時間 2 月 27 日下午 5:01。

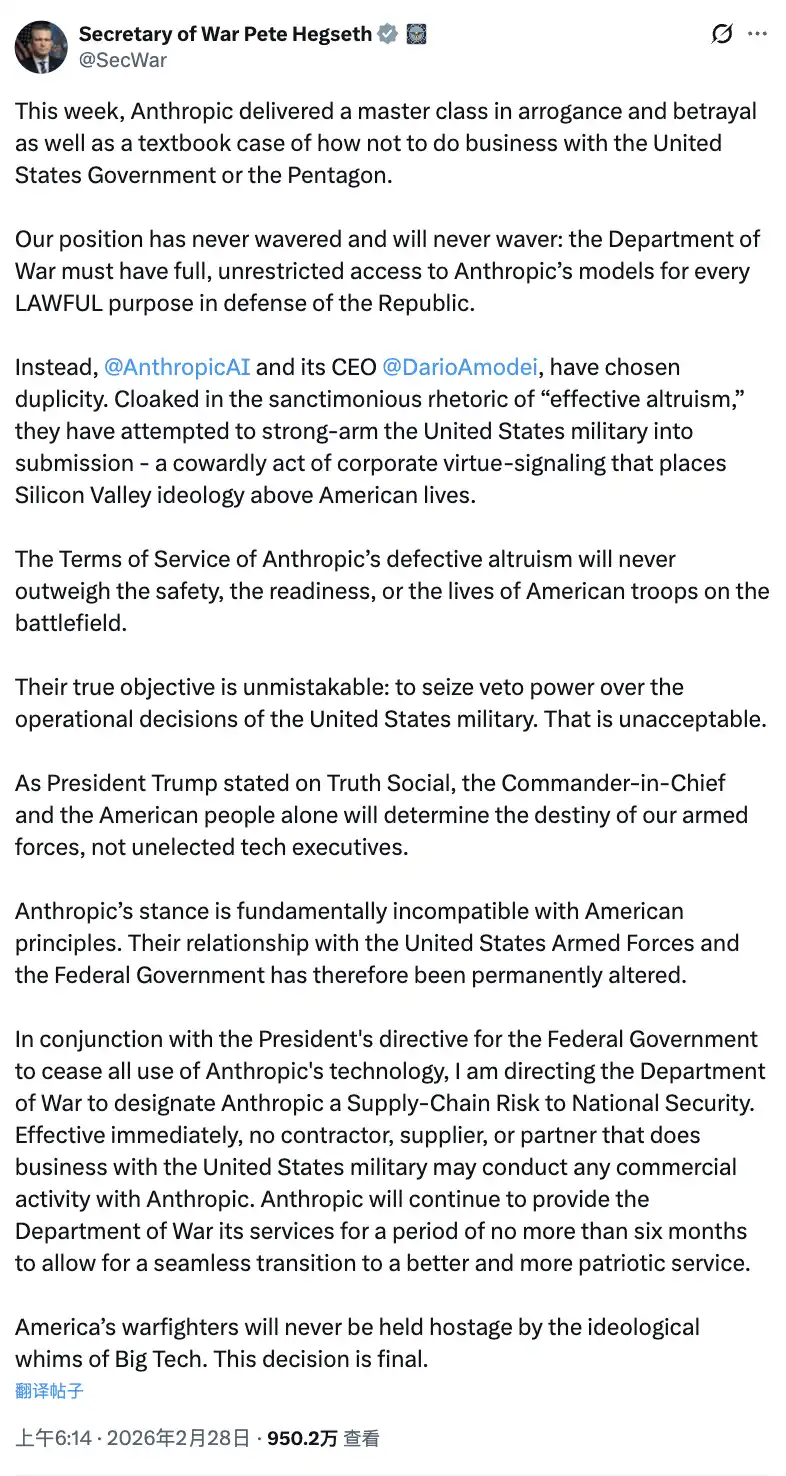

Anthropic 的最後通牒時間已到。Dario 沒有妥協。Trump 在 Truth Social 上宣布封禁,Hegseth 在 X 上發文將 Anthropic 列為「供應鏈風險」,Anthropic 宣布將通過法律途徑應對。

Hegseth 的聲明中有一句話值得注意:「Anthropic 的立場與美國原則根本不相容。」然而,在同一份聲明中,他表示 Anthropic 可以繼續向五角大廈提供服務「不超過六個月,以便平穩過渡」。也就是說,他們剛把一家公司定性為國家安全風險,卻仍在繼續使用該公司的產品。這個邏輯悖論,沒有人正面解釋。

幾小時後,Altman 發了那條推文。

回看他當天早些時候在全員會上的表述:他說希望 OpenAI 能「幫助局勢降溫」,並找到一個可以「為整個行業樹立框架」的解決方案。這不是一個被動等待的人的語氣。

這不是矽谷第一次見到這種操作。

2023 年,OpenAI 的非營利董事會以「不夠坦誠」為由解僱了 Altman,理由是他推進速度過快,內部溝通存在問題。五天後,Altman 帶著員工的集體支持信回來了,董事會解散。之後,他主導了公司從非營利架構向營利實體的重組,原本對公司有約束權的非營利使命,被包進了一個新的法律框架。

This time, it's called "Found a Common Framework".

Dario 輸了什麼?

Jerry McGinn,美國戰略與國際研究中心工業基礎研究中心主任,對這件事給出了一個冷靜的評價:「這對 Anthropic 是絕佳的公關,而他們根本不需要那 2 億美元。」

這個判斷在財務上是準確的。Anthropic 2025 年全年營收 140 億美元,估值 3800 億美元,最大股東亞馬遜不會因為一紙政府封禁令就重新考慮投資邏輯。法律途徑可能帶來轉機。IPO 估值大概率不受實質損害,「拒絕政府壓力,堅守安全原則」這個敘事,恐怕沒有任何公關預算能買到同等效果。

但有一件事,Dario 輸掉了。

AI 在軍事領域的實際使用標準,將由 OpenAI 在五角大樓內部制定,而不是 Anthropic。那個嵌進機密網絡的 safety stack,那些持有安全許可證的 OpenAI 研究員,那套持續追蹤 AI 行為的監控系統。它們在接下來的幾年裡,會生長成事實上的行業規範。

Anthropic 因為堅持原則而保住了立場,但失去了在規則制定過程中的席位。

而坐到那個席位上的人,是同一個在不到 12 小時內完成了從「聲援」到「簽約」轉變的人。

最諷刺的地方在於:最認真對待 AI 安全的公司,被趕出了最需要認真對待 AI 安全的地方。

接替它進去的公司,兩週前剛剛上線了將用戶對話話題接入廣告系統的機制,三個月前經歷了第三方數據洩露,更早些時候悄悄披露了一套可以把用戶舉報給執法機關的對話掃描系統。

在矽谷,Altman 這不到十二小時的操作有個名字。不叫背刺,叫 timing。

歡迎加入律動 BlockBeats 官方社群:

Telegram 訂閱群:https://t.me/theblockbeats

Telegram 交流群:https://t.me/BlockBeats_App

Twitter 官方帳號:https://twitter.com/BlockBeatsAsia